ResNet50结构详解:从源码剖析Bottleneck与网络层次

《习惯的解构:心理学教你重新构建生活》- 从结构层面剖析习惯 #生活知识# #生活心理学# #生活习惯改善# #生活习惯改变书籍#

源码ResNet封装 在torchvision中封装了Resnet的源码,下面通过对ResNet源码的分析进一步了解ResNet网络结构,方便对ResNet结构进行修改,同时学习网络源码的组织方式,方便日后搭建自己的神经网络

def resnet50(pretrained=False, **kwargs): """Constructs a ResNet-50 model. Args: pretrained (bool): If True, returns a model pre-trained on ImageNet """ model = ResNet(Bottleneck, [3, 4, 6, 3], **kwargs) if pretrained: model.load_state_dict(model_zoo.load_url(model_urls['resnet50'])) return model 123456789

从源码的入口出发,通过 model = ResNet(Bottleneck, [3, 4, 6, 3], **kwargs) 构造网络结构,主要分成两个部分即 Bottleneck 和 [3,4,6,3] 由这两个参数共同决定了ResNet50的网络结构 ,当pretrained 为true时,为model加载imageNet中预训练的参数。

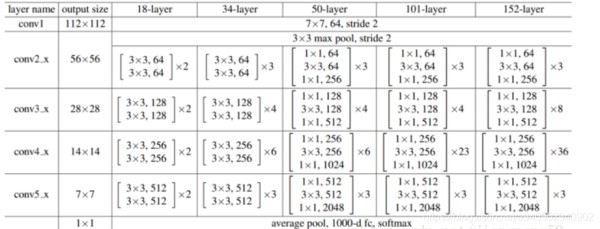

这里涉及到了Bottleneck这个类,[3,4,6,3]对应于上图中ResNet50中 conv2_x中 有三个(1164,3364,11256)卷积层的堆叠 ,同理conv3_中有4个(11128,33128,11512)卷积层的堆叠,resnet将卷积层分为4个大层,[3,4,6,3]代表每一个大层中11,33,1*1 卷积层组合的重复次数 总共1(第一个卷积层)+1(第一个池化层)+(3+4+6+3)*3=50层

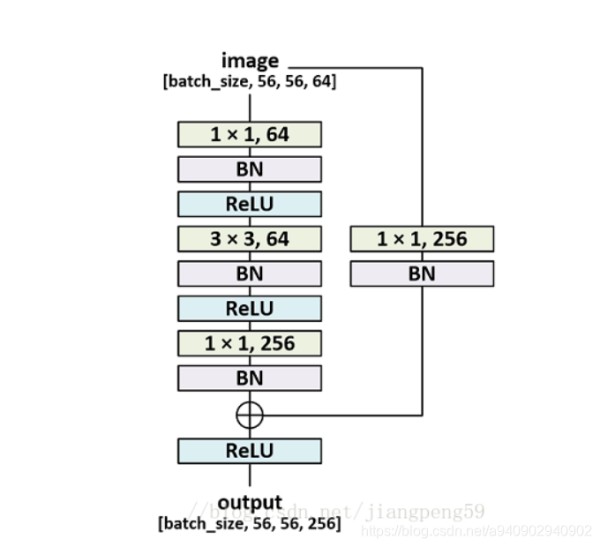

这里涉及到一个Bottleneck类,可以把一个Bottleneck当成一个基础的block就是对应上图的(11,33,11)卷积核大小的卷积层的组合

解释一下为什么输入Bottleneck之前是56 * 56 * 64 的,因为ResNet接受的图像大小为224 * 224 经过第一层卷积层

self.conv1 = nn.Conv2d(3, 64, kernel_size=7, stride=2, padding=3, bias=False)

floor((224-7+23)/2)+1=112

经过第一层池化之后

self.maxpool = nn.MaxPool2d(kernel_size=3, stride=2, padding=1)

floor((112+2*1-3)/2)+1=56

因此在输入到Bottleneck之前得到一个56(height)*56(weight)*64(channel)大小的feature map

class Bottleneck(nn.Module): expansion = 4 def __init__(self, inplanes, planes, stride=1, downsample=None): super(Bottleneck, self).__init__() self.conv1 = nn.Conv2d(inplanes, planes, kernel_size=1, bias=False) self.bn1 = nn.BatchNorm2d(planes) self.conv2 = nn.Conv2d(planes, planes, kernel_size=3, stride=stride, padding=1, bias=False) self.bn2 = nn.BatchNorm2d(planes) self.conv3 = nn.Conv2d(planes, planes * self.expansion, kernel_size=1, bias=False) self.bn3 = nn.BatchNorm2d(planes * self.expansion) self.relu = nn.ReLU(inplace=True) self.downsample = downsample self.stride = stride

12345678910111213141516因为1 * 1卷积核不改变feature map的大小,3 * 3卷积核padding=1 也不改变输入feature map的大小,因此经过一个Bottleneck组成的卷积层组操作后feature map大小不会改变

下面看一下Bottleneck的forward函数

def forward(self, x): residual = x out = self.conv1(x) out = self.bn1(out) out = self.relu(out) out = self.conv2(out) out = self.bn2(out) out = self.relu(out) out = self.conv3(out) out = self.bn3(out) if self.downsample is not None: residual = self.downsample(x) out += residual out = self.relu(out) return out 123456789101112131415

这里要留意一下downsample,因为feature map的大小不变 但是在经过Bottleneck 之后channel变成了原来的四倍,因此想要和原始的feature map相加 需要将原始的feature map 也变为原来的四倍 ,downsample 作用是residual+当前feature map时将维度统一

接下来分析ResNet 类的具体构成

class ResNet(nn.Module): def __init__(self, block, layers, num_classes=1000): self.inplanes = 64 super(ResNet, self).__init__() self.conv1 = nn.Conv2d(3, 64, kernel_size=7, stride=2, padding=3, bias=False) self.bn1 = nn.BatchNorm2d(64) self.relu = nn.ReLU(inplace=True) self.maxpool = nn.MaxPool2d(kernel_size=3, stride=2, padding=1) self.layer1 = self._make_layer(block, 64, layers[0]) self.layer2 = self._make_layer(block, 128, layers[1], stride=2) self.layer3 = self._make_layer(block, 256, layers[2], stride=2) self.layer4 = self._make_layer(block, 512, layers[3], stride=2) self.avgpool = nn.AvgPool2d(7, stride=1) self.fc = nn.Linear(512 * block.expansion, num_classes) for m in self.modules(): if isinstance(m, nn.Conv2d): nn.init.kaiming_normal_(m.weight, mode='fan_out', nonlinearity='relu') elif isinstance(m, nn.BatchNorm2d): nn.init.constant_(m.weight, 1) nn.init.constant_(m.bias, 0) def _make_layer(self

123456789101112131415161718192021222324网址:ResNet50结构详解:从源码剖析Bottleneck与网络层次 https://www.yuejiaxmz.com/news/view/514151

相关内容

ResNet结构分析详解神经网络各层的结构与功能

社区便民服务平台 源码,构建智慧社区生活圈,深度解析社区便民平台源码开发与应用

LSL脚本性能优化秘籍:代码剖析与效率提升策略

ResNet中残差块的理解(附代码)

物联网架构图

【机器学习】深度神经网络(DNN):原理、应用与代码实践

PHP+MySQL网络购物商城网站的设计与实现*(附源码 配置 文档)

网络安全学习路线图(2024版详解)

性能优化:从剖析到调整,全面提升软件性能