隐私保护深度学习技术:现状、挑战与未来

科技带来的便利与对隐私的保护是现代生活哲学的挑战 #生活知识# #生活哲学# #现代生活哲学#

摘要

当机器学习算法需要为训练过程访问高度敏感的数据时,存在挑战和问题。为了解决这些问题,人们发展了几种保护隐私的深度学习技术,包括安全多方计算和神经网络中的同态加密。也有几种方法可以对神经网络进行改进,使其适用于隐私保护环境。然而,在各种技术之间存在隐私和性能之间的权衡。本文讨论了隐私保护深度学习的研究现状,对各种方法进行了评价,比较了每种方法的优缺点,指出了深度学习在隐私保护领域存在的挑战和问题。

前言

机器学习,即人工智能(AI)的发明,开启了人类生活的一个新纪元。我们可以训练一台机器像人类一样做决策。机器学习一般分为训练阶段和测试阶段,为了利用机器学习取得更好的效果,在训练阶段需要大量的数据集。机器学习在社会工程、图像识别、医疗服务等领域都有应用的趋势。要想获得令人满意的机器学习结果,一个主要的挑战就是数据集的收集。由于数据将分散在个人身上,因此需要付出大量努力来收集这些数据。

敏感用户倾向于不情愿地将他们的私有数据提交给第三方。由于服务器端受到危害,将会发生数据泄露的风险,例如当我们使用云计算时。用户选择不将其机密数据存储在云中,因为他们担心有人会查看他们的私有数据,为了说服用户相信他们的数据安全和隐私,需要一种使用隐私保护数据的方法来输入深度学习中的训练过程。为此,发送到服务器的数据必须加密,并且在训练阶段也应该保持加密。这里的挑战是修改当前的深度学习技术,使其能够处理加密数据。在本文中,我们将讨论隐私保护深度学习(PPDL)技术的发展现状,对他们进行评估,比较每种技术的优缺点,并提出PPDL中存在的问题和挑战。

经典隐私保护技术

隐私保护技术被归类为能够处理加密数据的特殊工具。隐私保护技术的重要性在于能够在不泄露原始内容的情况下对数据进行计算。因此,它可以保证高度机密数据的隐私。关于在处理个人数据方面保护个人的第95/46/EC号指令是欧洲联盟根据人权法管理个人数据库处理的指令。该指令规定,“[数据]控制员必须实施适当的技术和组织措施,以保护个人数据免受意外或非法破坏或意外丢失、更改、未经授权的披露或访问,特别是在处理涉及通过网络传输数据的情况下,以及防止所有其他非法形式的处理。”隐私保护的目标就是基于这一规定。

同态加密1978年,Rivest et al.质疑是否存在任何加密方案来支持在不知道秘密信息的情况下对加密数据进行计算。例如,教科书上的RSA加密支持在没有私钥的情况下对加密数据进行乘法运算,我们称之为乘法同态加密(HE)。同样,如果一个系统支持在没有密钥的情况下对加密数据进行加法运算,我们称之为加法同态加密。

安全计算的概念于1986年由姚期智院士正式提出,并发明了乱码电路(GC)。在GC中,所有函数都被描述为一个布尔电路,并且使用不经意传输协议来不经意地传递信息。然后,Goldreich等人在1987年将该概念扩展到安全多方计算(MPC)。MPC的目的是解决在不使用任何可信第三方的情况下保护一组不可信用户中的用户隐私的协作计算问题。

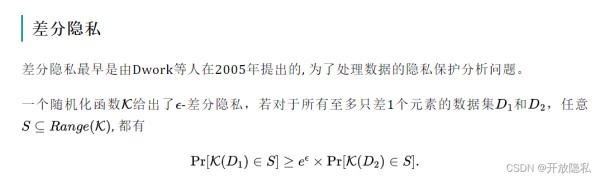

差分隐私处理受信任的数据管理者想要发布关于他/她的数据的一些统计数据而不泄露关于该数据的任何信息的情况。因此,无论是否包括用户数据,有权访问某些算法的输出的对手都会获得几乎相同的信息。应用差分隐私技术,对机器学习算法进行了大量的研究,如决策树、支持向量机、Logistic回归等。

深度学习中的隐私保护技术

这一节描述了深度学习技术的原始结构和隐私保护环境下必要的改动。

深度神经网络(DNN)激活层(Activation layer)

如图1所示,激活层(Activation layer)决定是否激活数据(值1)或不激活(值0)。激活层是对卷积层的输出进行数学处理的非线性函数。有几种众所周知的激活函数,例如整流线单元(RELU)、Sigmoid和tanh。由于这些函数是非线性的,如果我们使用这些函数来计算HE加密的数据,复杂度会变得非常高。因此,我们需要找到一个只包含乘法和加法的替换函数。替换函数将在稍后讨论。

网址:隐私保护深度学习技术:现状、挑战与未来 https://www.yuejiaxmz.com/news/view/523436

相关内容

智能家居安全:未来技术与隐私保护的平衡智能语音识别技术的现状与未来####

探索智能家居技术:现状与未来

未来智能家居技术的发展趋势与挑战

智能语音识别技术的现状与未来发展趋势####

隐私保护技术的发展:从传统到现代

探索未来网络:物联网技术的革新与挑战

智能语音识别技术:现状、挑战与未来发展趋势探讨

未来智能交互:AI技术在日常生活中的应用与挑战

AI人工智能助理的未来发展趋势:技术创新与挑战