集成学习:装袋法Bagging与随机森林

深度学习模型的集成学习,如bagging和boosting #生活技巧# #学习技巧# #深度学习技巧#

集成学习(ensemble learning)是时下非常流行的机器学习算法,它本身不是一个单独的机器学习算法,而是通 过在数据上构建多个模型,集成所有模型的建模结果。前言

例如:随着人工智能的不断发展,机器学习这门技术也越来越重要,很多人都开启了学习机器学习,本文就介绍了机器学习的基础内容。

一、集成学习是什么?

集成学习本身不是一个单独的机器学习算法,而是通过再数据上构建多个模型,集成所有模型的建模结果。

目标:集成学习算法本身是考虑多个建模器的建模结果,汇总得到一个综合的结果,总的来说就是比单个模型获得更好的分类和回归效果表现。或者说在机器学习的众多算法中,我们的目标是学习出一个稳定的且在各个方面表现都较好的模型,但实际情况往往不这么理想,有时我们只能得到多个有偏好的模型(弱监督模型(弱评估器,基评估器),在某些方面表现的比较好)。集成学习就是组合这里的多个弱监督模型一起得到一个更好更全面的强监督模型。

通俗理解:有一道判断题,一群学习不好的人怎么去做能让题目的成功率比较高呢。

在这里就有两种方法:

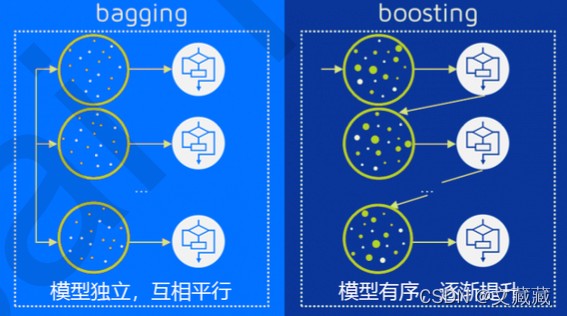

第一种是序列集成方法(提升法Boosting):

先让学渣A做一遍,然后再让学渣B做,且让B重点关注A做错的那些题,再让C做,同样重点关注B做错的,依次循环,直到所有的学渣都把题目做了一遍为止

第二种就是并行集成方法(装袋法Bagging):

多个学渣一起做, 每个人随机挑选一部分题目来做,最后将所有人的结果进行汇总,然后根据将票多者作为最后的结果

图:

全称为bootstrap aggregating。它是一种有放回的抽样方法,其算法过程如下:

- 从原始样本集中抽取训练集。每轮从原始样本集中使用有放回的方法抽取n个训练样本(在训练集中,有些样本可能被多次抽取到,而有些样本可能一次都没有被抽中)。共进行k轮抽取,得到k个训练集。(k个训练集之间是相互独立的)

- 每次使用一个训练集得到一个模型,k个训练集共得到k个模型。(注:这里并没有具体的分类算法或回归方法,我们可以根据具体问题采用不同的分类或回归方法,如决策树、感知器等)

- 对分类问题:将上步得到的k个模型采用投票的方式得到分类结果;对回归问题,计算上述模型的均值作为最后的结果。(所有模型的重要性相同)

1.随机森林-代表集成学习技术水平的算法(有放回的抽样bagging)

1.1 简介随机森林是一种有监督学习算法,是以CART决策树为基学习器的集成学习算法。随机森林非常简单,易于实现,计算开销也很小,在分类和回归上表现出非常惊人的性能,因此,随机森林被誉为“代表集成学习技术水平的方法”。

网址:集成学习:装袋法Bagging与随机森林 https://www.yuejiaxmz.com/news/view/656070

相关内容

Boosting和Bagging面试笔试整理3:深度学习机器学习面试问题准备(必会)

数据结构学习笔记之树和森林的存储结构与相关应用

《森林》生存方法与角色一览 森林新手入门指南

机器学习算法的性能优化:提高学习效率的关键方法

透气袋 山东康纳包装有限公司 集装袋,吨袋,防静电集装袋,导电集装袋,化工集装袋、医药食品集装袋、防膨胀集装袋、防静电集装袋、导电集装袋、TYPE D 集装袋、阻燃集装袋

森林步道让人与自然更亲近

未来城市森林构建靠什么?

找东北虎、野外搜救、森林防火……“无人机+热成像”显身手

ChatGPT4.0最新功能和使用技巧,助力日常生活、学习与工作!