自适应提升算法,英文Adaboost的全称是Adaptive Boosting。是一种有监督的集成学习。核心思想是对某一特定的训练集训练多个弱分类器,然后根据相应策略将这些弱分类器结合起来,构成最终的强分类器。

自适应提升法的核心思想是,在每次分类任务中重点关注被错误分类的样本,减少对被分类正确的样本的关注。这样逐步可以得到一个比较清晰的分类方向,即一个强分类器。

SAMME算法

算法的提出:

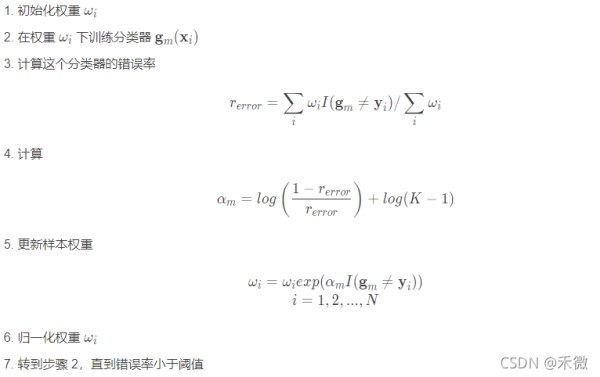

SAMME是一种多分类自适应提升算法。对于自适应提升法,要想在每轮训练中增大对分类错误标签的关注程度,即给误分类样本增加权重,则要保证每轮训练的错误率都小于0.5,(如果大于0.5,则在下一轮训练时会有更多的分类错误的选项)。对于二分类问题,每个样本被预测正确的概率为0.5,要达到0.5以上的正确率,是相对容易的。但是对于多分类任务来说,如果有K个类别,则被预测正确的概率就变成了1/K,要想达到0.5以上就变的更难。SAMME算法就是针对这一问题提出的。

具体算法过程见:https://blog.csdn.net/weixin_43298886/article/details/110927084

SAMME.R算法

与SAMME算法不同的是可以利用概率信息进行分类。SAMME.R算法通过损失近似的思想,将加权分类模型的概率输出信息与boosting方法相结合。SAMME.R中的字母“R”代表“Real”,意味着模型每轮迭代的输出为实数。

Adaboost.R2

利用权重分配的思想,处理实际应用中的回归问题。